UN NOSTRO TIMORE SU AI SI È PUNTUALMENTE AVVERATO…CHI LO HA COSTRUITO VI HA IMMESSO GLI STESSI STEREOTIPI E INTENTI DISCRIMINANTI CONTRO LE DONNE!*

Alla “International Conference on AI in Cybersecurity” è stata lanciata una denuncia molto preoccupante: chi ha costruito i software per ChatGPT ha trasmesso alla AI anche le discriminazioni, i pregiudizi e gli stereotipi di genere contro le donne, evidentemente affinché siano perpetuati e si mantengano ben radicati nella nostra cultura influenzando ogni sfera del nostro vivere!

Durante la terza edizione dell’International Conference on AI in Cybersecurity, due giovani ricercatori hanno esposto una indagine scientifica circa il rapporto tra AI e stereotipi di genere.

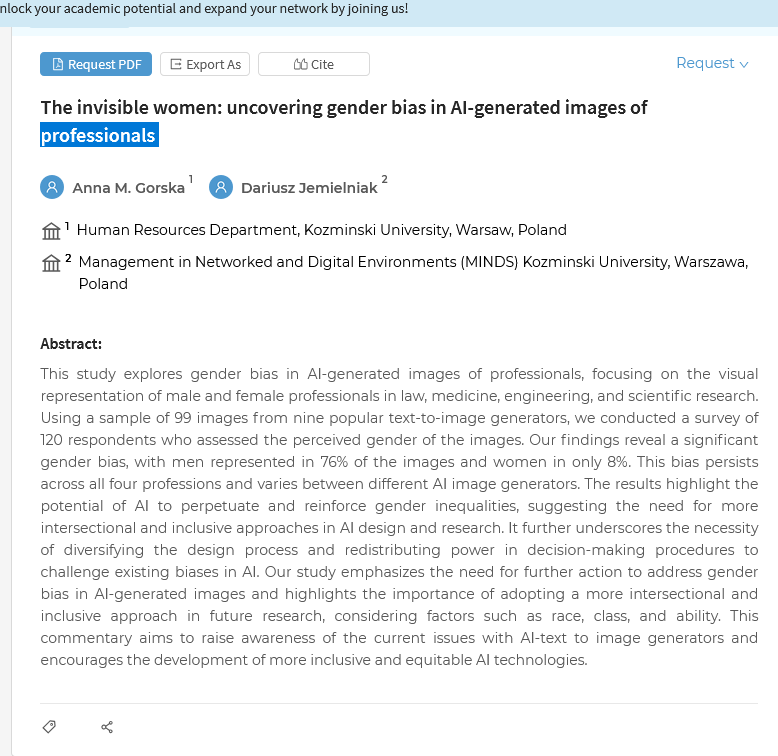

Lo studio e’ stato pubblicato nel 2023 e si intitola The invisible women: uncovering gender bias in AI-generated images of professionals

v. in https://www.tandfonline.com/doi/full/10.1080/14680777.2023.2263659

I ricercatori sono due accademici polacchi, Anna Maria Gorska e Dariusz Jemielniak provenienti dalla Akademia Leona Koźmińskiego (Kozminski University). Anna Maria Gorska e’ Pd.D e Human Resources Department alla Kozminski University, e Dariusz Jemielniak, Professore, fa parte del Management in Networked and Digital Environments (MINDS) della Kozminski University, Warszawa, Poland.

Essi hanno chiesto alla AI di generare migliaia di immagini su professioni e azioni professionali (medici, avvocati, ingegneri, scienziati ecc) poi le hanno classificate.

Risultato?

Il 91% delle immagini erano di uomini!

La rappresentanza femminile peggiore è stata quella dei medici, nonostante le donne costituiscano quasi metà di professionisti. Le immagini riguardanti genitori che si occupavano ei figli, il 75% ritraeva donne. Per “lavare il pavimento”, il 65%. Ma per i “#CEO”, il 100% ritratti sono stati uomini.

Eppure le donne rappresentano il 53,7% della popolazione europea ed hanno spesso un titolo di studio terziario essendo occupate come professionisti o tecnici nei settori della scienza e della tecnologia,

Le donne rappresentano il 48,1% dei dottorandi ed in Polonia la percentuale è addirittura del 56,3% ma ancora oggi paradossalmente solo 1/4 dei Professori Universitari e’ donna purtroppo (dati della Commissione Europea del 2018/2019).

Insomma: accusiamo i #talebani di annientare i diritti delle donne in #Afghanistan ma anche i nostri informatici occidentali che hanno realizzato ChatGPT continuano a trasmettere un mondo in cui alle donne dovrebbe essere riservato solo un ruolo di cura famigliare e subordinato rispetto a quello maschile!

Questo studio esplora i pregiudizi di genere nelle immagini dei professionisti generate dall’intelligenza artificiale, concentrandosi sulla rappresentazione visiva dei professionisti maschi e femmine nel campo del diritto, della medicina, dell’ingegneria e della ricerca scientifica.

Utilizzando un campione di 99 immagini provenienti da nove popolari generatori di testo in immagine, abbiamo condotto un sondaggio su 120 intervistati che hanno valutato il genere percepito delle immagini.

I nostri risultati rivelano un significativo pregiudizio di genere, con gli uomini rappresentati nel 76% delle immagini e le donne solo nell’8%.

Questo pregiudizio persiste in tutte e quattro le professioni e varia tra i diversi generatori di immagini AI.

I risultati evidenziano il potenziale dell’intelligenza artificiale nel perpetuare e rafforzare le disuguaglianze di genere, suggerendo la necessità di approcci più intersezionali e inclusivi nella progettazione e nella ricerca sull’intelligenza artificiale. Sottolinea inoltre la necessità di diversificare il processo di progettazione e di ridistribuire il potere nelle procedure decisionali per sfidare i pregiudizi esistenti nell’intelligenza artificiale.

Il nostro studio sottolinea la necessità di ulteriori azioni per affrontare i pregiudizi di genere nelle immagini generate dall’intelligenza artificiale ed evidenzia l’importanza di adottare un approccio più intersezionale e inclusivo nella ricerca futura, considerando fattori come razza, classe e abilità. Questo commento mira ad aumentare la consapevolezza delle attuali problematiche relative ai generatori di testo e immagini basati sull'intelligenza artificiale e incoraggia lo sviluppo di tecnologie di intelligenza artificiale più inclusive ed eque.

v. video di Anna Maria in https://www.facebook.com/reel/330178100028654

*Su tale argomento ed i nostri timori circa il fatto che i software di AI potessero riflettere i pregiudizi dei loro progettisti perpetuando una cultura di discriminazioni e stereotipi sulle donne, avevamo già scritto un articolo pubblicato da Il coraggio delle Donne di Lucia Ottavi